Interaktionsformen der Zukunft

Über adaptive Touch-Oberflächen zur fehlerfreien Gesteninteraktion

Studiengang

Interaktive Medien (B.A./B.Sc.)Interaktive Mediensysteme (M. A.)

Projektbeschreibung

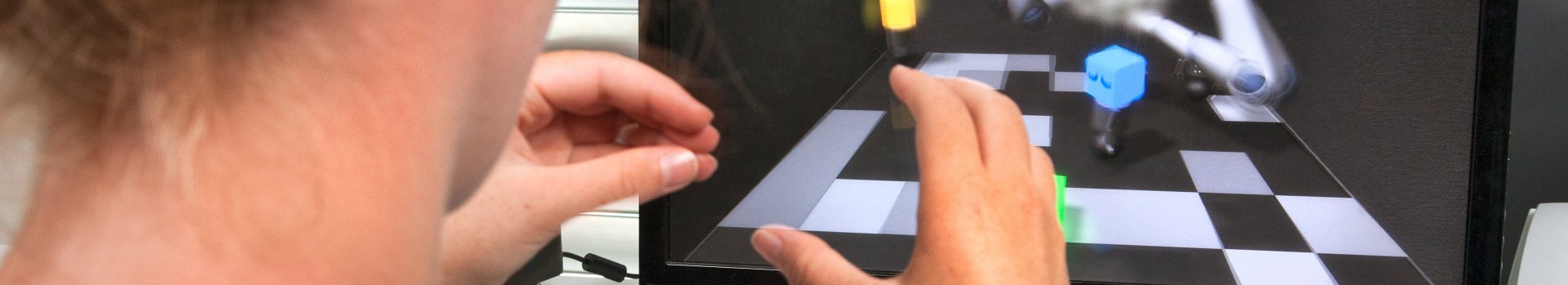

Die Interaktion mit Smartphones über Touch ist heute so selbstverständlich wie früher via Tastatur und Maus. Dennoch sind viele Fragen zur Effizienz, Präzision und Fehleranfälligkeit unter unterschiedlichen Randbedingungen (Haltung, Bildschirmgröße, Bewegung etc.) in der Grundlagenforschung ungeklärt. Hinzu kommt die Frage nach den Interaktionsformen der Zukunft, wenn Virtual Reality (VR) und Augmented Reality (AR) zum Alltag gehören werden wie Smartphones heute. Hier wird die Interaktion per Gestik immer wichtiger. Im neuen Interaktionslabor der Hochschule Augsburg werden grundlegende Modelle zur Touch- und Gesteninteraktion erforscht.

Im neu eingerichteten Interaktionslabor (Informatik und Gestaltung) wird mit neuester Technik die Interaktion zwischen Mensch und Endgeräten untersucht. Ein Tracking-System – bekannt aus der Filmindustrie unter dem Begriff Motion Capture – kann mit hoher Präzision menschliche Körperbewegung erfassen. Wir untersuchen sowohl „traditionelle“ Touch-Interaktion als auch zukunftsträchtige Gestik-Interaktion. Unsere Studien basieren auf Fitts‘ Law, ein einfaches Modell zum Zusammenhang zwischen Interaktionsdauer, Zielgröße und -distanz, das es uns erlaubt, Messungen zu normalisieren und so zu vergleichen (mittlerweile Industriestandard: ISO 9241).

Wie hältst du‘s mit dem Smartphone?

Smartphones lassen sich unterschiedlich halten und bedienen: hochkant oder quer, mit Zeigefinger oder Daumen. Wie wirkt sich das auf die Eingabe aus? Wann passieren Fehler? Müsste sich das Design nicht automatisch anpassen, wenn man das Handy dreht oder den Eingabefinger wechselt? Wohingegen das bekannte Responsive Design darauf abzielt, das Äußere für verschiedene Displaygrößen anzupassen, meinen wir mit Responsive Interaction, dass einzelne Bedienelemente ihr Verhalten ändern, sobald sich der Kontext ändert.

In einer aktuellen Studie konnten wir klare – aber auch sehr differenzierte – Unterschiede zwischen verschiedenen Smartphone-Haltungen nachweisen. Die Eingabegeschwindigkeit ist z. B. dann am höchsten, wenn man das Handy quer hält und mit zwei Daumen bedient. Dennoch ist die einhändige Bedienung in hochkant mit dem Daumen sehr populär, weil die zweite Hand frei ist, um z. B. eine Tasche zu tragen. Diese Haltung erwies sich jedoch als langsam und fehleranfällig. Ausnahme ist die Region rechts-unten in Nähe des Daumens.

Ähnlich haben wir weitere Regionen und Bewegungsrichtungen identifiziert, die nachweislich schneller, fehlerfreier oder präziser sind. Insgesamt gibt es keine perfekte Art, ein Smartphone zu halten, wohl gibt es Möglichkeiten, die Benutzerschnittstelle so zu gestalten, dass je nach Priorität (z. B. schnell vs. fehlerfrei) und Haltung die Bedienoberfläche automatisch angepasst wird.

Is Bigger better? Trotz der Allgegenwart von Smartphones setzt sich Touch auf größeren Flächen erst nach und nach durch. Wie ändert sich dort die Charakteristik der Interaktion? Corinna List hat dies in ihrer Bachelorarbeit anhand von drei Bildschirmgrößen – Notebook (13"), Standrechner (28") und Großbildschirm (70") – untersucht. Sie fand heraus, dass große Bildschirme (70") die Interaktion verlangsamen, möglicherweise durch die Reibung und Ermüdung entlang größerer Strecken. Kleine Bildschirme (13") verursachen viele Fehler, wahrscheinlich durch das bekannte fat finger problem: der Finger verdeckt das Ziel und hat keinen klar definierten Kontaktpunkt. Die mittlere Bildschirmgröße (28") wird subjektiv als weniger anstrengend empfunden und verursacht deutlich weniger Fehler als der kleine Bildschirm. Dies scheint somit die „goldene Mitte“ zu sein.

Gorillas und Gesten

Da Gestensteuerung in den Bereichen VR, AR und in Computerspielen immer prominenter wird, hat sich Julia Krammling in ihrer Masterarbeit mit dem sogenannten Gorilla-Arm-Problem beschäftigt. Gestensteuerung hat den entscheidenden Nachteil, dass die Armhaltung und die Größe der Geste den User zusehends ermüden. Hängt aber die Wahrnehmung dieser Ermüdung nicht von der Gesamtsituation ab? Gestikuliert man mit großen oder kleinen Gesten, tut man dies vor einer großen Bildschirmprojektion oder vor einem normalen Monitor?

Krammling analysierte diese Frage in einem aufwändigen Experiment mit 45 Versuchspersonen. Ihre zentralen Befunde ergaben, dass die Bildschirmgröße die Wahrnehmung der Anstrengung nicht direkt beeinflusst. Große Gesten werden immer auch als anstrengender empfunden. Wichtig ist aber, dass die Probanden vor allem auch „mehr Spaß“ bei den großen Gesten empfanden und bestimmte Bewegungsformen (z. B. Bewegungsrichtung in Richtung der Gravitation) bei großen Gesten sogar leichter fallen könnten. Die Studie ist erst der Beginn einer grundlegenden Erforschung von Gesteninteraktion.

Beteiligte Personen

Prof. Dr. Michael Kipp

Faculty for Computer Science

[Bitte aktivieren Sie Javascript]

Encouragement

HSA_Projektbudget,

Antrag „Interaktionslabor“