Daedalos

Modulares System zur experimentellen Untersuchung von Navigationsmodellen

Projektbeschreibung

Das „Project_Daedalos“ erkundet die methodischen Verknüpfungsoptionen einer Navigation mit zwei Freiheitsgraden auf eine Bewegung im virtuellen Raum mit drei Freiheitsgraden. Kombiniert mit prozeduraler visueller und auditiver Gestaltung entsteht gleichzeitig ein experimentelles und exploratives Erlebnis von Virtual Reality (VR). Dazu wurde das Sportgerät ICAROS mit aktueller VR-Technologie verbunden. Die Herausforderung ist es, den zweiachsigen Input des ICAROS nachvollziehbar in 3D-Bewegungen in der virtuellen Welt umzuwandeln und neue Interfaces schnell zu entwickeln und zu erfahren.

Modulares Node-Interface

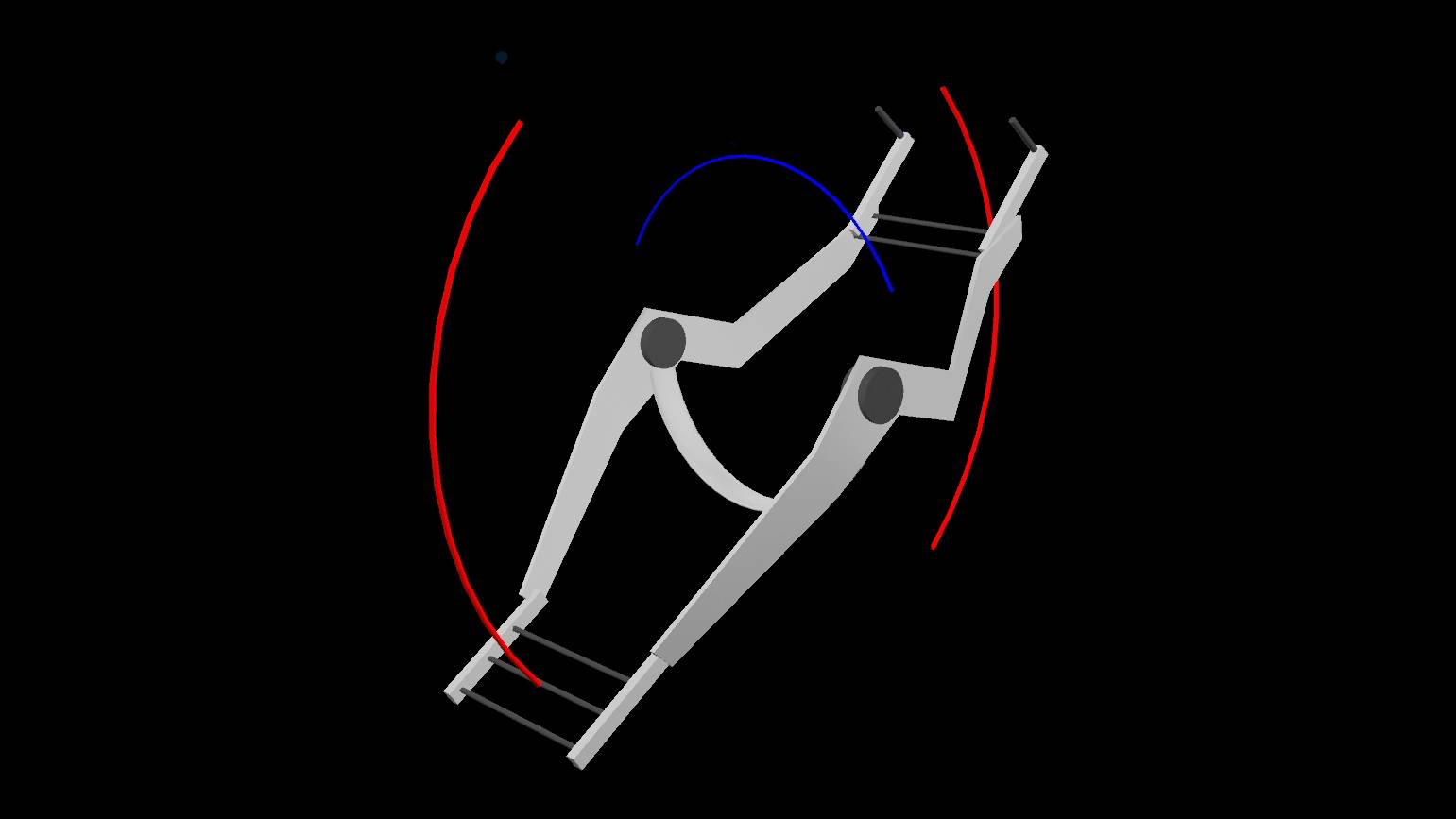

Durch das modulare Interface wird das Interaktionsverhalten zwischen dem ICAROS und der Bewegung im virtuellen Raum festgelegt. Im Interface wird genau definiert, auf welche Variablen sich die Bewegung der User:innen auswirken. Das wird durch das Verbinden der symbolischen In- und Output-Docks visualisiert.

Indem man so In- und Outputs verbindet, bestimmt man, wie sich der digitale ICAROS bewegen lässt. Die Intensität dieser Bewegungen lässt sich an jeder Linie separat justieren, indem man einen jeweiligen Faktor eingibt.

Um den User:innen weitere Freiheiten zu geben, sind zusätzlich Optionen – wie Variablenfunktionen, die Werte jeden Frames des Programms auf eine speichernde Variable rechnen und das Ergebnis weitergeben – oder eine Threshold-Funktion, die zwei einfache Werte miteinander vergleicht und ein Boolean-Ergebnis weitergibt, als Nodes auf dem Canvas erstellbar und durch die Linien in das Mapping einbindbar.

Allerdings werden im Interface selbst noch keine Werte ausgerechnet, es dient nur zur schematischen Darstellung, um den User:innen einen leichten Zugang zum Node-System zu geben. Das Node-System selbst arbeitet während die VR-Anwendung aktiv ist und rechnet die eigentlichen Werte separat vom Interface aus. Beim Programmstart der VR-Anwendung wird lediglich ein Verbindungsprotokoll an das Node-System übergeben, in dem im XMLFormat definiert wird, welche Docks miteinander verbunden sind und welche Faktoren eingerechnet werden müssen. Diese Methode wird in der Masterarbeit zum gleichnamigen Projekt von Remon Vogel erklärt.

Generative Gestaltung

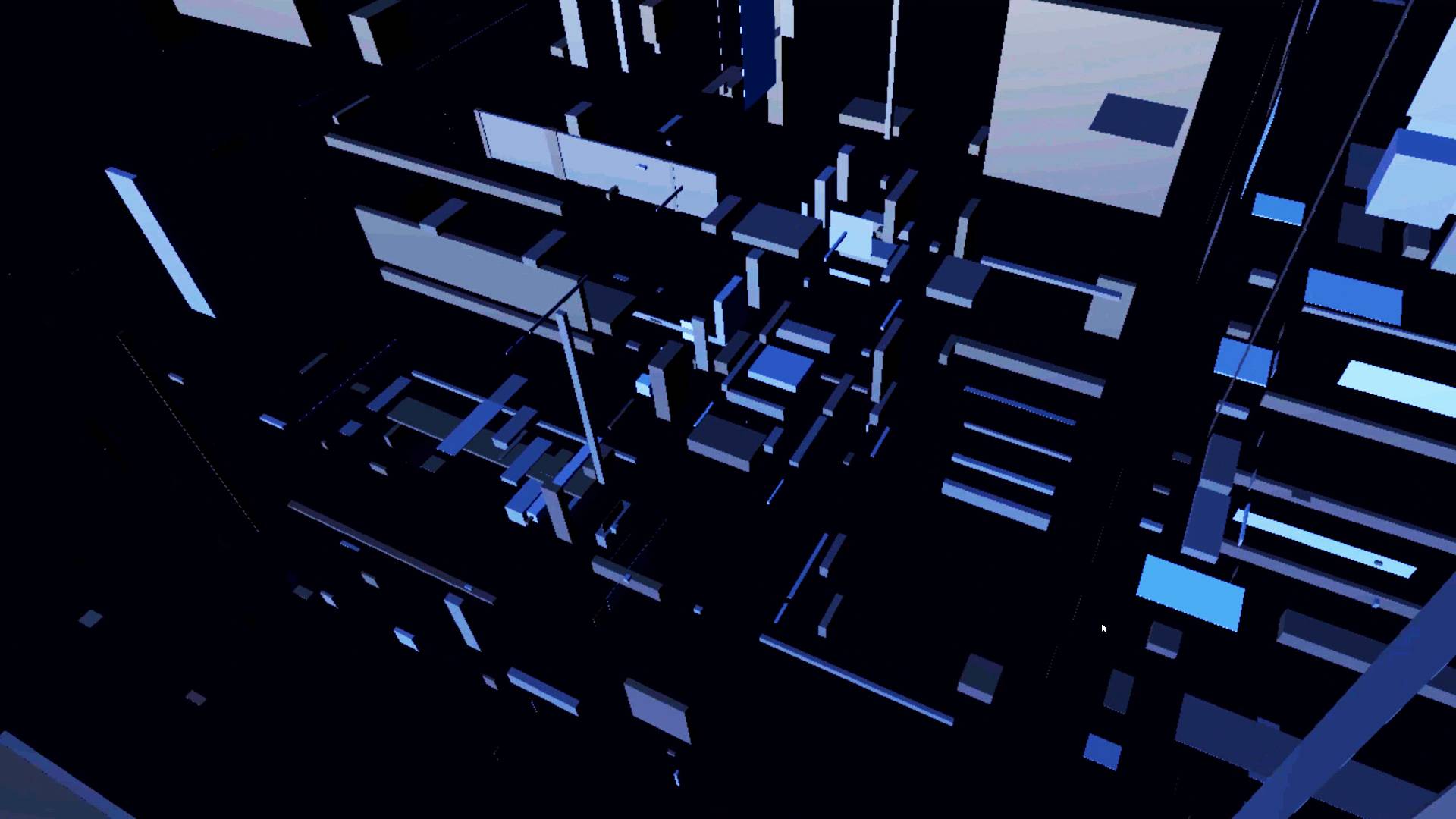

Der Grundstein für die meisten entstandenen Gestaltungen ist eine Gitterstruktur aus Würfeln, die beim Starten der VR-Anwendung um die Position der User:innen im virtuellen Koordinatensystem platziert werden. Um die Illusion einer unendlichen virtuellen Welt zu erreichen, ist das Gitter mit der Funktionalität implementiert, sich schrittweise mit den User:innen in der Welt mitzubewegen.

Um aus einer monotonen Umgebungsgestaltung auszubrechen, wurden verschiedene Noise-Algorithmen wie Perlin- oder Worley-Noise, die ein pseudo-zufälliges Wertebild erzeugen, auf Attribute der Würfel angewandt. Beispiele dafür sind die Kantenlänge, Farbe, oder Rotation des Würfels – oder auch das Offset des Würfels zum Gitter.

Um den Charakter einer zwar zufällig generierten, aber gleich bleibenden Welt zu erreichen, werden diese Werte aus den absoluten Positionen der Würfel in der 3D-Welt durch eine modifizierte dreidimensionale Perlin-Noise-Funktion errechnet. Weil die Werte aus dem „World Space“ bezogen werden, kann man sich so in der 3D-Welt wieder an Orte zurück bewegen, an denen man schon einmal war.

Interaktives Sounddesign

Die Daten aus dem VR-Programm werden an eine dedizierte Musik-Software (hier: Ableton Live) weitergegeben, die zeitgleich zur VR-Anwendung ein Audioprogramm spielt, das interaktiv auf die Events aus der digitalen Welt reagiert. Als Transferprogramm zwischen der „Unity Game Engine“ und „Live“ wird das Netzwerkprotokoll „Open Sound Control“ (OSC) benutzt. In „Ableton“ wurden mehrere Spuren mit Klängen erstellt und daraus eine Taktfolge geschnitten, die sich dauerhaft wiederholt und auf deren digitale Instrumenten-Parameter die OSCNachrichten Einfluss haben.

Beispielsweise spricht das seitliche Lehnen auf dem ICAROS die Tonhöhe eines Synthesizers an, der einen höheren oder tieferen Ton abspielt, je nachdem wie weit man sich nach rechts oder links verlagert. Der Sound wurde auch auf bestimmte Input-Events konfiguriert. Wenn ein Lehnen nach Vorne zum Beispiel in der VR-Welt eine Beschleunigung der Geschwindigkeit durch den Raum bewirkt, kann man auch den aktuellen Beschleunigungswert an ein Musikinstrument schicken, um auditives Feedback auf den Input der User:innen und auf die Bewegung im digitalen Raum zu geben

Fazit und Ausblick

Das Projekt erforscht die Möglichkeiten der freien Bewegung im virtuellen Raum und nutzt aktuelle VR-Entwicklungen, um die Navigation in einer 3DUmgebung experimentell zu untersuchen. Nach der Umsetzung des modularen Bewegungskonzepts als Master-Projekt von Remon Vogel wird zur Zeit in der Arbeit von Dirk Widmann der Fokus auf Interaktive Gestaltung und Sound Design gelegt.

Projektleitung

Ansprechpartner | |

Telefon: | +49 821 5586-3427 |

Weitere Beteiligte

Dirk Widmann (Student) | |

Fakultät für Gestaltung | |

Remon Vogel (Student) | |

Fakultät für Gestaltung | |